-

Cos’è il passaggio diretto PCI in Proxmox?

-

Requisiti hardware e compatibilità

-

Verifica del supporto hardware prima della configurazione

-

Abilitazione di IOMMU nel BIOS

-

Configurazione di Proxmox VE per il pass-through PCI

-

Preparazione dei dispositivi per l’assegnazione diretta

-

Assegnazione di dispositivi alle macchine virtuali tramite interfaccia web

-

Convalida post-passthrough all’interno del sistema operativo guest

-

Suggerimenti avanzati e risoluzione dei problemi

-

Soluzione di backup a livello aziendale per le tue VM Proxmox

-

Domande frequenti sul pass-through PCI Proxmox

-

Conclusione

Il passaggio diretto PCI è una delle funzionalità più potenti di Proxmox VE. Consente di assegnare direttamente alle macchine virtuali dispositivi PCIe fisici, come GPU, schede di rete (NIC) o controller di archiviazione. Ciò può migliorare le prestazioni, ridurre la latenza ed abilitare carichi di lavoro avanzati che richiedono l’accesso diretto all’hardware. Ma come si configura? In questa guida esamineremo tutto, dai concetti di base fino alla risoluzione avanzata dei problemi, per permettervi di padroneggiare il passaggio diretto PCI in Proxmox nel vostro ambiente.

Cos’è il passaggio diretto PCI in Proxmox?

Il passaggio diretto PCI consente a una macchina virtuale di controllare un dispositivo PCIe fisico come se fosse installato direttamente sulla sua scheda madre. Quando si assegna un dispositivo mediante il passaggio diretto PCI in Proxmox, tale dispositivo diventa invisibile al sistema host fino a quando la macchina virtuale non lo rilascia: si tratta di un’effettiva isolamento hardware.

Perché questo è importante? Alcuni carichi di lavoro necessitano di accesso diretto all’hardware specializzato per motivi di velocità o compatibilità:

Assegnare una GPU per l’apprendimento automatico o la codifica video.

Transito attraverso una scheda di rete ad alta velocità per dispositivi di rete.

Assegnare un controller di archiviazione a ZFS o ad altri sistemi file all’interno di una macchina virtuale.

Al centro di questa funzionalità vi è l’IOMMU (Input-Output Memory Management Unit). L’IOMMU mappa in modo sicuro gli accessi alla memoria dei dispositivi tra le macchine virtuali e la RAM fisica. Sulle piattaforme Intel questa tecnologia è denominata VT-d; su AMD è nota come AMD-Vi o modalità SVM. Senza il supporto dell’IOMMU sia a livello di CPU che di scheda madre, il pass-through PCI in Proxmox non funzionerà in modo affidabile, né tantomeno funzionerà affatto.

La maggior parte delle CPU moderne di classe server supporta nativamente queste funzionalità, ma controlla sempre la documentazione del modello specifico prima di iniziare.

Requisiti hardware e compatibilità

Prima di configurare il pass-through PCI su Proxmox, assicurati che l’hardware sia pienamente supportato; in caso contrario, potresti incontrare ostacoli fastidiosi in un secondo momento.

Primo: Supporto CPU

I processori Intel devono supportare VT-d.

I processori AMD richiedono la modalità AMD-Vi/SVM.

Verifica le specifiche del tuo processore online, se non ne sei sicuro; cerca “VT-d” (Intel) o “AMD-Vi”/“SVM” (AMD).

Secondo: Supporto per scheda madre

Non tutti i chipset implementano la funzionalità completa dell’IOMMU, anche se la CPU lo supporta! Le schede server di solito funzionano meglio; alcune schede per utenti finali riducono le funzionalità in questo ambito.

Consulta il modello della tua scheda sul sito del produttore oppure cerca nei forum della community storie di successo relative al PCI passthrough su Proxmox.

Terzo: Compatibilità del dispositivo

La maggior parte dei dispositivi PCIe può essere passata attraverso—including GPU (NVIDIA/AMD/Intel), schede di rete (NIC), controller USB, schede RAID—ma alcuni presentano particolarità:

I dispositivi multifunzione potrebbero richiedere che tutte le funzioni vengano trasmesse contemporaneamente.

Le schede abilitate SR-IOV possono presentare più “funzioni” virtuali da condividere tra le macchine virtuali.

Se possibile, eseguire prima i test con hardware di riserva prima di distribuire carichi di lavoro critici!

Quarto: Impostazioni del firmware

Aggiornare il firmware BIOS/UEFI prima di iniziare: le versioni precedenti potrebbero non includere le opzioni fondamentali di virtualizzazione richieste da Proxmox VE 7.x e versioni successive.

Verifica del supporto hardware prima della configurazione

Conviene verificare la compatibilità prima di apportare modifiche:

1. Avvia la shell di Proxmox.

2. Eseguire lscpu — verificare la presenza delle flag di virtualizzazione (vmx per Intel; svm per AMD).

3. Controlla i dispositivi PCI disponibili:

lspci -nnk

Identifica quali dispositivi desideri assegnare in seguito.

4. Cerca i log dmesg:

dmesg | grep -i iommu

Se non compare alcuna informazione sull’attivazione dell’IOMMU dopo l’avvio—neppure dopo aver abilitato le impostazioni BIOS—potrebbe essere necessario un hardware diverso o aggiornamenti del firmware.

Confermando ora questi punti, eviterai di sprecare tempo successivamente per risolvere problemi relativi a configurazioni non supportate!

Abilitazione di IOMMU nel BIOS

L’abilitazione di IOMMU a livello di firmware è essenziale: il resto del passaggio diretto PCI in Proxmox dipende dal suo corretto funzionamento fin dall’accensione del sistema:

1. Riavvia il server ed entra nella configurazione BIOS/UEFI (Canc, F2 o tasto simile durante l’avvio).

2. Trova le impostazioni di virtualizzazione nelle sezioni Avanzate > Configurazione CPU o Chipset.

Per Intel: abilitare VT-d/Tecnologia di virtualizzazione Intel per I/O diretto.

Per AMD: abilitare la Modalità SVM, AMD-Vi o semplicemente IOMMU, a seconda della dicitura presente nel menu.

3. Impostare su “Abilitato” qualsiasi opzione trovata relativa a “IOMMU”, “VT-d” o “Modalità SVM”.

4. Se disponibile, abilitare ACS (Access Control Services): ciò consente di isolare i dispositivi multifunzione in gruppi separati, evitando che si interferiscano reciprocamente durante l’assegnazione.

5. Salvare le modifiche (F10) ed uscire dall’impostazione BIOS/UEFI.

Se non si è sicuri che le impostazioni siano state applicate dopo il riavvio in Proxmox:

dmesg | grep -e DMAR -e IOMMU

Dovresti vedere righe simili a DMAR: IOMMU abilitato (Intel) o AMD-Vi: IOMMU abilitato (AMD).

Senza una corretta configurazione del firmware qui, nessuna modifica software riuscirà a far funzionare il pass-through PCI su Proxmox!

Configurazione di Proxmox VE per il pass-through PCI

Ora che il firmware è pronto, configuriamo Proxmox passo dopo passo:

Passo 1: Determinare il tipo di bootloader

Proxmox utilizza GRUB (il più comune) o systemd-boot, a seconda del metodo di installazione:

Esegui:

efibootmgr -v

Se nell’output viene menzionato systemd-boot, è quello che stai utilizzando; in caso contrario, supponi GRUB, a meno che non sia stato installato personalmente un altro bootloader.

Perché questo è importante? Il modo in cui impostiamo i parametri del kernel varia tra di loro, e tali parametri sono fondamentali per attivare le funzionalità di pass-through PCI di Proxmox al momento dell’avvio!

Passo 2: Modificare i parametri di avvio del kernel

I parametri del kernel indicano a Linux come gestire le estensioni di virtualizzazione durante l’avvio iniziale:

Per gli utenti di GRUB:

1. Aprire /etc/default/grub con un editor di testo:

nano /etc/default/grub

2. Individuare la riga che inizia con GRUB_CMDLINE_LINUX_DEFAULT.

3a. Nei processori Intel aggiungere:

quiet intel_iommu=on iommu=pt

3b. Sui processori AMD aggiungere:

quiet amd_iommu=on iommu=pt

Nota: i kernel moderni abilitano spesso automaticamente AMD-Vi se SVM/IOMMU sono impostati nel BIOS, ma l’aggiunta di entrambi i flag garantisce affidabilità anche dopo gli aggiornamenti!

4. Salva il file (Ctrl+X, quindi Y, quindi Invio).

5. Aggiornare la configurazione di GRUB affinché le modifiche abbiano effetto al prossimo riavvio:

update-grub

Per gli utenti di systemd-boot:

1. Aprire /etc/kernel/cmdline:

nano /etc/kernel/cmdline

2. Aggiungere i parametri appropriati come indicato sopra (intel_iommu=on iommu=pt oppure amd_iommu=on iommu=pt) alla fine della riga, dopo le voci esistenti come quelle relative a root/zfs.

3. Salvare il file, quindi aggiornare la configurazione del bootloader:

proxmox-boot-tool refresh

Cosa significano questi flag?

intel_iommu=on: Abilita il motore VT-d sui chipset Intel supportati;amd_iommu=on: Attiva la funzione equivalente sui chipset AMD supportati;iommu=pt: Imposta la modalità pass-through in modo che i dispositivi non utilizzati non vengano bloccati dall’assegnazione;quiet: Riduce il rumore della console durante l’avvio: non è strettamente necessario, ma mantiene i log ordinati!

Passaggio 3: Caricare i moduli kernel VFIO

I moduli VFIO («Virtual Function IO») consentono il trasferimento sicuro di dispositivi PCIe dallo spazio kernel del sistema operativo host direttamente alle macchine virtuali guest tramite lo stack QEMU/KVM:

Modifica il file /etc/modules affinché questi moduli vengano caricati automaticamente a ogni avvio:

nano /etc/modules

Aggiungi le righe in fondo, se non già presenti:

vfio vfio_iommu_type1 vfio_pci vfio_virqfd # Opzionale, ma migliora la stabilità della gestione delle interruzioni!

Salvare il file al termine (Ctrl+X, quindi Y).

Passaggio 4: Aggiornare initramfs e riavviare il server

L’aggiornamento di initramfs garantisce che i nuovi driver e le nuove configurazioni siano inclusi fin dalle prime fasi del processo di avvio di Linux:

Esegui entrambi i comandi seguenti come utente root/sudo:

update-initramfs -u -k all reboot

Dopo il riavvio completato con successo, procedere immediatamente ai passaggi di verifica indicati di seguito—non saltarli!

Passo 5: Verificare che tutto funzioni correttamente fino a questo punto

Una volta riconnessi, eseguire i seguenti controlli:

Verificare che l’IOMMU sia stato attivato correttamente—

dmesg | grep -e DMAR -e IOMMU

Cerca messaggi di conferma come "DMAR: IOMMU abilitato" (Intel) oppure "AMD-Vi: trovato" / "IOMMU abilitato" (AMD).

Verifica lo stato del reindirizzamento delle interruzioni—

dmesg | grep 'remapping'

Ci si aspettano righe come "DMAR-IR: Enabled IRQ remapping...", che indicano un funzionamento corretto — requisito fondamentale, in particolare quando si assegnano GPU o schede di rete (NIC) che richiedono interruzioni MSI/MSI-X all’interno delle macchine virtuali!

Se uno dei due comandi non restituisce alcun risultato pertinente, controllare attentamente i passaggi precedenti prima di procedere ulteriormente con la configurazione del pass-through PCI in Proxmox!

Preparazione dei dispositivi per l’assegnazione diretta

Ora inizia la preparazione effettiva dei dispositivi: il fulcro di qualsiasi distribuzione Proxmox con pass-through PCI riuscita! Ecco come garantire un trasferimento sicuro dal kernel host al contesto della macchina virtuale guest...

Verificare l’isolamento del dispositivo mediante i gruppi IOMMU

Ogni dispositivo PCIe appartiene a un «gruppo IOMMU». I dispositivi che condividono lo stesso gruppo non possono essere assegnati in modo indipendente: devono essere gestiti insieme a causa delle risorse di bus condivise o dei limiti hardware imposti direttamente dalla progettazione del chipset!

Per elencare chiaramente i gruppi eseguire—

find /sys/kernel/iommu_groups/ -type l | sort | while read link; do \ group=$(echo $link | cut -d'/' -f5); \ device=$(basename $link); \ echo "Gruppo $group : $(lspci -nns $device)"; done;

Identifica il dispositivo o i dispositivi di destinazione: se è l’unico nel proprio gruppo, ottimo! In caso contrario, prova a spostare fisicamente la/e scheda/e tra diversi slot oppure, se disponibile, abilita l’override di ACS («Access Control Services») nel BIOS...

Considerare l’aggiunta di un parametro del kernel solo come ultima risorsa—

pcie_acs_override=downstream,multifunction

per suddividere gruppi ostinati—attenzione però alle implicazioni per la sicurezza, poiché le garanzie di isolamento rigoroso vengono perse quando si utilizzano tecniche di sovrascrittura!

Aggiungi alla blacklist i driver host in modo che non acquisiscano per primi il dispositivo

Per molte GPU, schede di rete (NIC) e controller di archiviazione, i driver predefiniti di Linux acquisiscono il controllo troppo precocemente, impedendo un corretto passaggio a VFIO… Soluzione? Aggiungi esplicitamente tali driver alla blacklist—

Modifica /etc/modprobe.d/blacklist.conf:

Per le GPU NVIDIA aggiungere le righe—

blacklist nouveau blacklist nvidia blacklist nvidiafb blacklist nvidia_drm

Per le GPU AMD aggiungere—

blacklist amdgpu blacklist radeon

Per le iGPU Intel aggiungere—

lista nera i915

Salva il file al termine! Nota—valido solo per server headless; non inserire nella lista nera l’adattatore video primario utilizzato dalla console host, a meno che non esista un percorso alternativo di gestione remota...

Associare gli ID dispositivo al driver VFIO all’avvio

Trovare gli ID venditore/dispositivo utilizzando—

lspci -nnk # Cerca il formato [vendorID]:[deviceID] # Esempio di estratto dell’output…

# 01:00.0 Controller grafico compatibile VGA [0300]: NVIDIA Corporation GP107GL [Quadro P400] [10de:1cb3] # ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ ^^^^ ^^^^ # Descrizione &......# 01:00.0 Controller grafico compatibile VGA [0300]: NVIDIA Corporation GP107GL [Quadro P400] [10de:1cb3] # ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ ^^^^ ^^^^ # Descrizione &......# 01:00.0 Controller grafico compatibile VGA [0300]: NVIDIA Corporation GP107GL [Quadro P400] [10de:1cb3] # ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^ ^^^^ ^^^^ # Descrizione ID fornitore e ID dispositivo rispettivamente! # # Se la scheda dispone anche di funzionalità audio, vedrai qualcosa del genere...# 01:00.1 Dispositivo audio [0403]: Controller audio ad alta definizione NVIDIA Corporation GP107GL [10de:0fb9] # # Entrambi gli ID devono essere associati insieme! # nano /etc/modprobe.d/vfiod/vfio.conf # Aggiungi la riga seguente sostituendo opportunamente gli ID.options vfio-pci ids=10de:1cb3,10de:0fb9 # update-initramfs -u -k all # Rigenera nuovamente l’initramfs! reboot # È necessario un ulteriore riavvio.Ora il driver VFIO richiede automaticamente questi esatti ID ogni volta che il sistema viene avviato: non sarà più necessario alcun intervento manuale..# 01:00.# 01:00...

Assegnazione di dispositivi alle macchine virtuali tramite interfaccia web

Una volta completata la preparazione iniziale, l’assegnazione dell’hardware reale tramite interfaccia web è semplice ma potente...

1. Selezionare la macchina virtuale di destinazione nell’albero di navigazione a sinistra all’interno della bacheca dell’interfaccia web;

2. Vai alla scheda Hardware;

3. Fare clic sul pulsante in grassetto denominato Add, quindi scegliere l’opzione «PCI Device»;

4. Nella finestra di dialogo, selezionare la modalità "Raw Device", quindi scegliere la voce desiderata corrispondente all’output precedente del comando lspci;

5. Per le schede multifunzione, selezionare le caselle di controllo «All Functions» e «Primary GPU», ove applicabile;

6. Le opzioni avanzate includono l’attivazione/disattivazione di «PCI Express», «ROM-Bar», ecc. — abilitarle solo se indicato nelle documentazioni del produttore o nelle guide della community specifiche per il tipo/modello della scheda!

7. Fare clic sul pulsante in grassetto contrassegnato come "Add".

Avvia o riavvia la macchina virtuale successivamente: il sistema operativo guest dovrebbe ora rilevare il dispositivo fisico reale esattamente come farebbe un’installazione su hardware fisico...

Convalida post-passthrough all’interno del sistema operativo guest

Assegnare non è sufficiente: vuoi una prova che tutto funzioni come previsto! Ecco come gli amministratori convalidano rapidamente il successo, indipendentemente dal fatto che i sistemi guest siano Windows o Linux…

Sui sistemi guest Linux

Aprire la finestra del terminale all’interno del sistema operativo guest ed eseguire—

lspci | grep VGA # Dovrebbe mostrare la stringa prevista del modello/fornitore della GPU.lsmod | grep vfio_pci # Dovrebbe confermare che il modulo vfio-pci è stato caricato attivamente.dmesg # Analizza il buffer del log verso la fine per individuare in particolare errori/avvisi relativi al dispositivo(i) passato(i) in modalità pass-through! glxinfo # Controllo utile per verificare che il renderer OpenGL corrisponda al nome/versione previsti della GPU dedicata.ethtool <interfaccia> # Per le schede di rete conferma che la velocità del collegamento e le funzionalità corrispondono alle aspettative.smartctl # Per i controller di archiviazione convalida i dati SMART visibili, interrogabili, ecc..

Sui sistemi Windows guest

Aprire Gestione dispositivi e controllare le voci Schede video/Controller audio/etc.—gli elementi passati vengono visualizzati senza triangoli di avvertenza/marchi di esclamazione una volta installati i driver corretti.......

Se compare un codice di errore (ad esempio «Errore 43», frequente con le schede NVIDIA): consultare i suggerimenti per la risoluzione dei problemi riportati di seguito relativi all’occultamento della firma dell’ipervisore o alle soluzioni alternative!

Suggerimento strumento opzionale: per analisi approfondite utilizzare l’utilità NirSoft DevManView, che fornisce un’analisi dettagliata comprensiva di versione/data/stato del driver per ciascun componente rilevato...

Suggerimenti avanzati e risoluzione dei problemi

Anche gli amministratori esperti incontrano talvolta difficoltà… Di seguito sono riportate soluzioni collaudate per la maggior parte dei problemi più comuni riscontrati oggi durante la distribuzione del pass-through PCI su Proxmox—

Impostare sempre il tipo di macchina virtuale su «q35» abbinato al firmware UEFI OVMF, ogni qualvolta possibile: ciò massimizza la compatibilità, in particolare con l’assegnazione delle GPU!

Passare TUTTE le funzioni appartenenti alla stessa scheda insieme, ad esempio: grafica + blocco audio HDMI; altrimenti i sistemi guest Windows/Linux potrebbero non inizializzarsi in modo silenzioso!

Installa i driver ufficiali più recenti NELL’OS guest—non nell’host—per la scheda o il controller assegnato…

Soluzione alternativa per il codice di errore 43 di NVIDIA: nel file di configurazione della macchina virtuale (.conf situato in

/etc/pve/qemu-server/<vmid>.conf) aggiungere la riga:args:-cpu host,kvm=on,hv_vendor_id=null. Ciò nasconde la firma di KVM/QEMU ingannando i controlli del driver…Alcune GPU AMD più vecchie o di fascia media presentano un bug di reimpostazione che ne impedisce il riutilizzo tra avvii/arresti multipli senza dover eseguire un riavvio completo… Soluzione? Installare sul lato host il modulo DKMS open-source

vendor-reset, seguendo attentamente le istruzioni su GitHub…In caso di errori di mapping delle interruzioni, provare ad aggiungere il parametro del kernel:

vfio_iommu_type1.allow_unsafe_interrupts=1. Utilizzare esclusivamente come misura temporanea in attesa di una correzione adeguata, poiché disabilita i controlli rigorosi sulla sicurezza…Il passaggio dei controller USB richiede spesso l’intero hub/gruppo a causa dei limiti progettuali del chipset… Confermare il raggruppamento tramite script precedenti o l’output di lspci…

Gli SSD NVMe vanno in timeout? Aggiungi il flag del kernel:

nvme_core.default_ps_max_latency_us=0.

Ricordate: documentate sempre ogni modifica effettuata lungo il percorso, in modo che il ripristino o la risoluzione dei problemi rimanga semplice anche a distanza di mesi…

Soluzione di backup a livello aziendale per le tue VM Proxmox

Dopo aver configurato carichi di lavoro avanzati utilizzando il pass-through PCI in Proxmox VE, è fondamentale proteggere tali macchine virtuali da eventi di perdita dati—dalla cancellazione accidentale agli attacchi ransomware fino ai guasti hardware—il che ci conduce naturalmente alla valutazione di strategie di backup specificamente progettate per ambienti aziendali come il vostro.

Vinchin si distingue come soluzione professionale per il backup delle macchine virtuali, progettata specificamente tenendo conto delle esigenze aziendali, e offre un supporto robusto non solo per Proxmox VE, ma anche per VMware vSphere/ESXi/vCenter, Hyper-V, oVirt/RHV/OLVM, XCP-ng/XenServer/Citrix Hypervisor e ambienti cloud OpenStack KVM/ZStack/Huawei FusionCompute/H3C CAS UIS/Sangfor HCI: in totale, oltre quindici principali piattaforme di virtualizzazione a livello mondiale! Poiché in questo caso stai lavorando specificamente con Proxmox, l’integrazione nativa di Vinchin garantisce flussi di lavoro di protezione senza interruzioni, appositamente progettati per l’architettura di questa piattaforma, oltre che per le altre menzionate sopra, qualora in futuro venga introdotta un’infrastruttura ibrida.

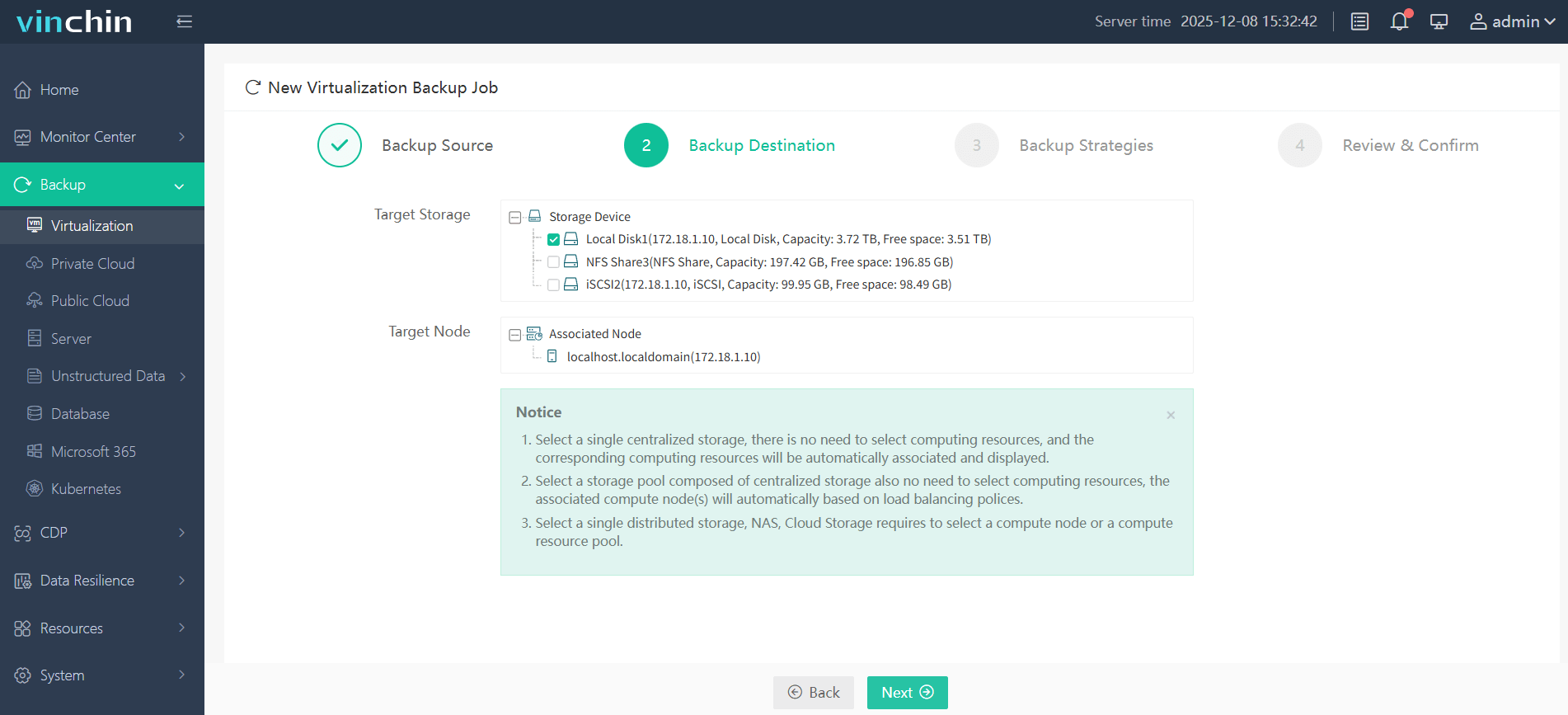

I punti salienti includono la tecnologia di backup incrementale perpetuo, che riduce al minimo l’utilizzo dello spazio di archiviazione registrando soltanto i blocchi modificati dopo un primo backup completo, nonché motori integrati di deduplica e compressione che riducono drasticamente l’impronta dei backup senza compromettere la velocità di ripristino. Vinchin consente inoltre la migrazione V2V cross-platform tra gli hypervisor supportati, offrendo flessibilità ai team IT durante gli aggiornamenti o le transizioni verso il cloud. Altre funzionalità di rilievo comprendono backup pianificati/ripetuti, crittografia dei dati, trasmissione multithread, politica di conservazione GFS e capacità di ripristino granulare, tutte accessibili tramite una console web intuitiva progettata per essere appresa rapidamente anche da utenti non specialisti.

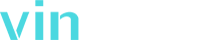

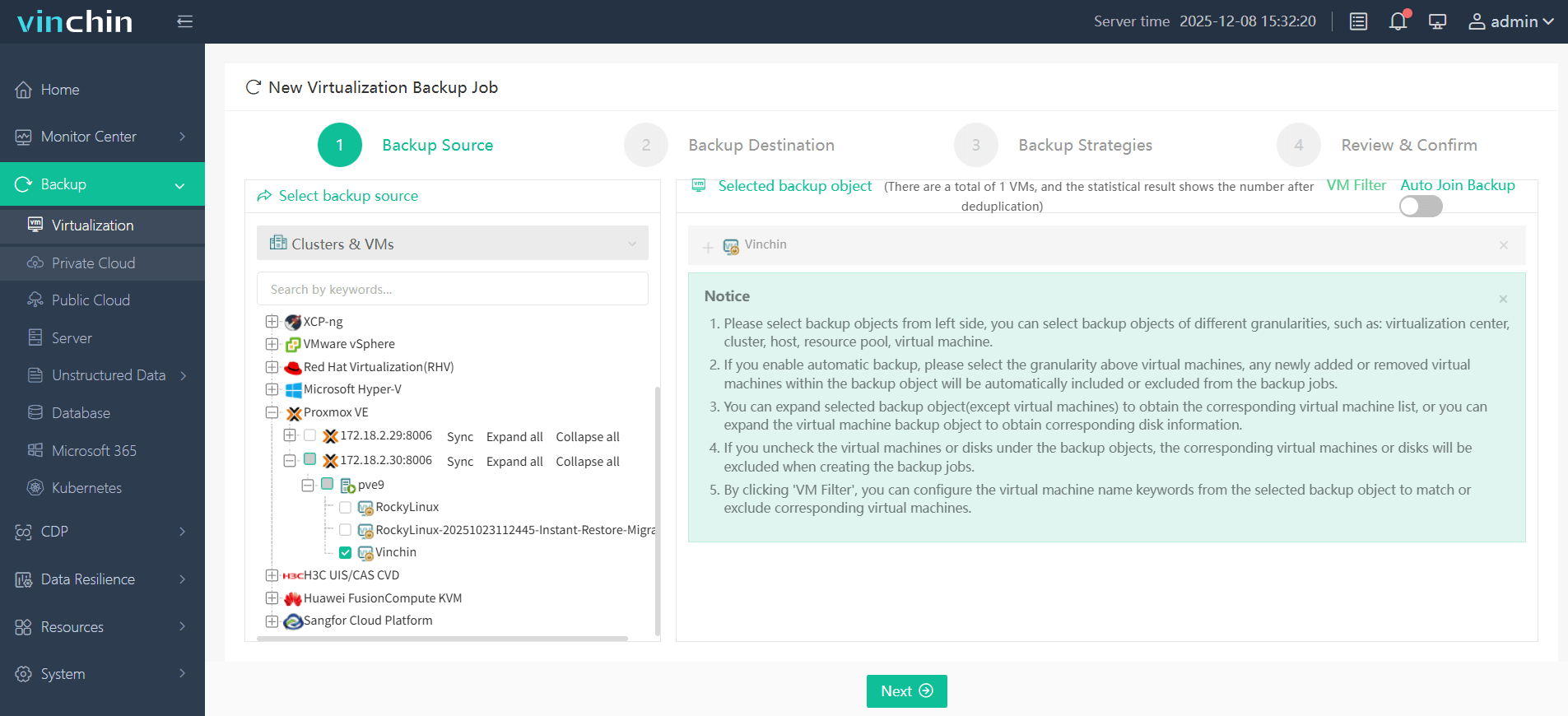

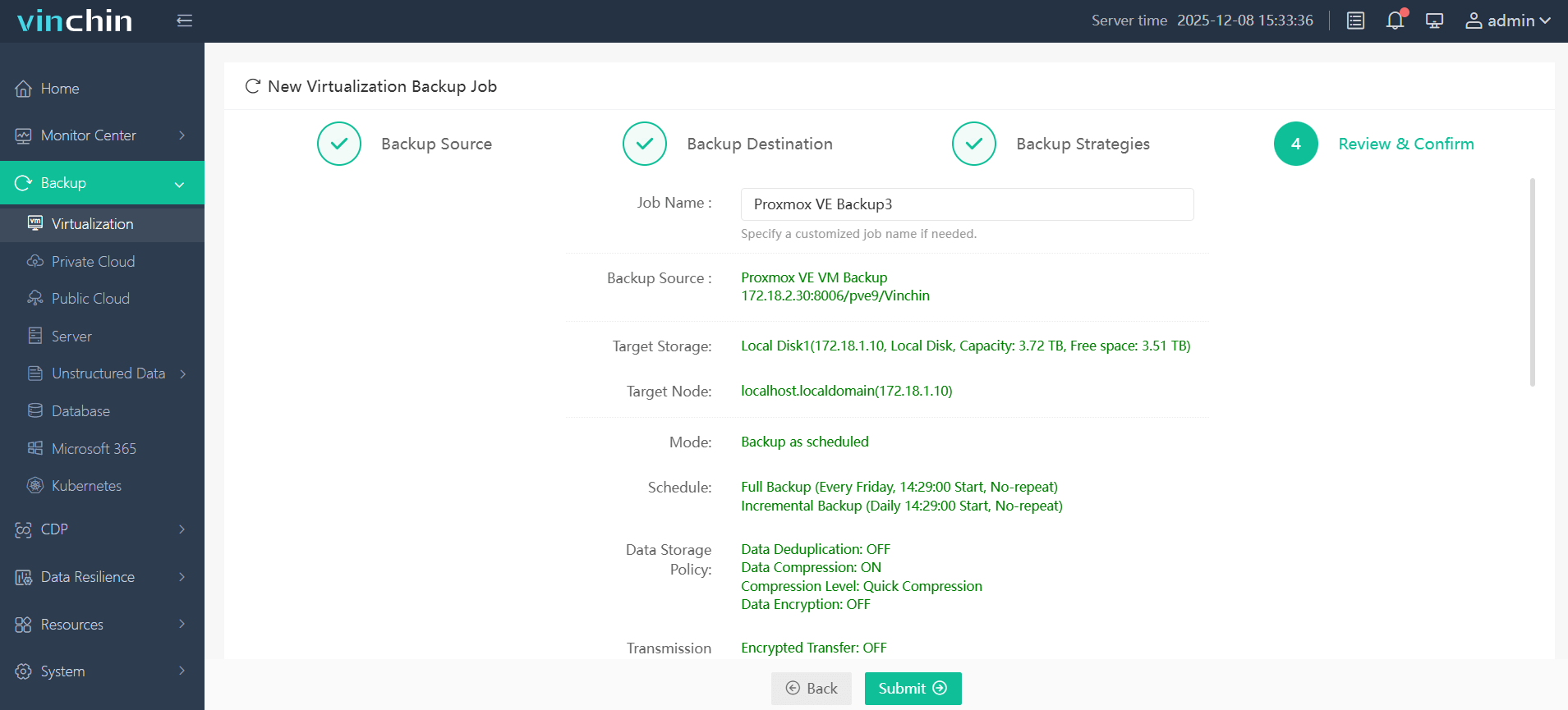

Eseguire il backup di una macchina virtuale Proxmox richiede soltanto quattro semplici passaggi nell’interfaccia web di Vinchin:

(1) Selezionare la macchina virtuale di destinazione dall’inventario;

(2) Scegli l’archiviazione di backup preferita;

(3) Configurare le strategie di backup;

(4) Invia il lavoro—con monitoraggio integrato dello stato di avanzamento.

Nessuno scripting complesso richiesto e le operazioni di ripristino sono altrettanto semplici, grazie agli strumenti di ripristino istantaneo e ripristino granulare integrati sull’affidabile architettura del motore Vinchin, già adottata a livello globale da migliaia di organizzazioni, grandi e piccole. Scarica la loro versione di prova gratuita completa, valida per sessanta giorni, e sperimenta in prima persona un’implementazione senza sforzo: basta cliccare qui sotto, iniziare subito e proteggere oggi stesso ciò che conta di più!

Domande frequenti sul pass-through PCI Proxmox

Q1: Come posso ripristinare in sicurezza il mio server nel caso in cui la GPU in pass-through causi uno schermo nero dopo il riavvio?

A1: Connettersi in remoto tramite SSH, modificare i file blacklist/vfio.conf, rimuovere le voci problematiche, aggiornare initramfs e quindi riavviare; in caso di problemi, utilizzare la porta grafica integrata, se disponibile.

Q2: Perché il mio controller USB scompare sia dall’host che dall’ospite dopo l’assegnazione?

A2: Molti hub/controllori USB condividono il loro gruppo; passare sempre l’intero gruppo anziché una singola funzione, ogni volta che possibile.

Q3: Quali miglioramenti prestazionali posso aspettarmi rispetto all’hardware virtuale emulato?

A3: Velocità quasi native – tipicamente oltre il 90% della velocità nativa – purché non siano presenti colli di bottiglia altrove (ad esempio, allocazione insufficiente di CPU/RAM).

Conclusione

Il pass-through PCI sblocca il pieno potenziale di Proxmox VE concedendo alle macchine virtuali l’accesso diretto all’hardware, garantendo prestazioni quasi native per GPU, schede di rete (NIC) e controller di archiviazione. Il successo dipende da una rigorosa compatibilità hardware (supporto IOMMU della CPU e della scheda madre) e da una configurazione precisa: abilitare l’IOMMU nel BIOS, associare i dispositivi ai driver VFIO e isolare correttamente le funzioni.

Condividi su: